近年、AIを活用した音楽制作ツールが次々と登場してきている中、ソニーコンピュータサイエンス研究所(ソニーCSL)が実用レベルの人工知能作曲ツール「Flow Machines Professional」を開発していることはご存知でしょうか?現在進行形で進化し続けているこのツールは、DAW上で動作するプラグインで、AIが提案したメロディーなどをクリエイターが選ぶことで、自分にはない発想で作曲ができ、極端にいえば音楽の知識がない人でも作曲を可能にしてくれる、夢のようなアイテムです。

現在のところFlow Machines Professionalはソニーグループ内での活用ツールという位置づけで、一般には解放されていないのですが、ソニーミュージックでの音楽制作で実践投入されています。たとえば「Dive/Connect @ Zepp Online」のオープニング曲や「Tokyo LosT Tracks -サクラチル-」の一部の楽曲は制作されているといった具合。ソニーCSLではドイツのSteinberg本社とも情報のやりとりをしつつCubaseで動作する形で検証を進めており、まさに最先端の技術開発を行っているのです。このFlow Machines Professionalが、どういった経緯で開発されたのかなど、ソニーCSLのプロジェクトエンジニア岸治彦さんにお話を聞くことができたので、紹介してみたいと思います。

ソニーCSLが研究開発するAIアシスト作曲ツール、「Flow Machines」

ソニーCSLが研究開発するAIアシスト作曲ツール、「Flow Machines」

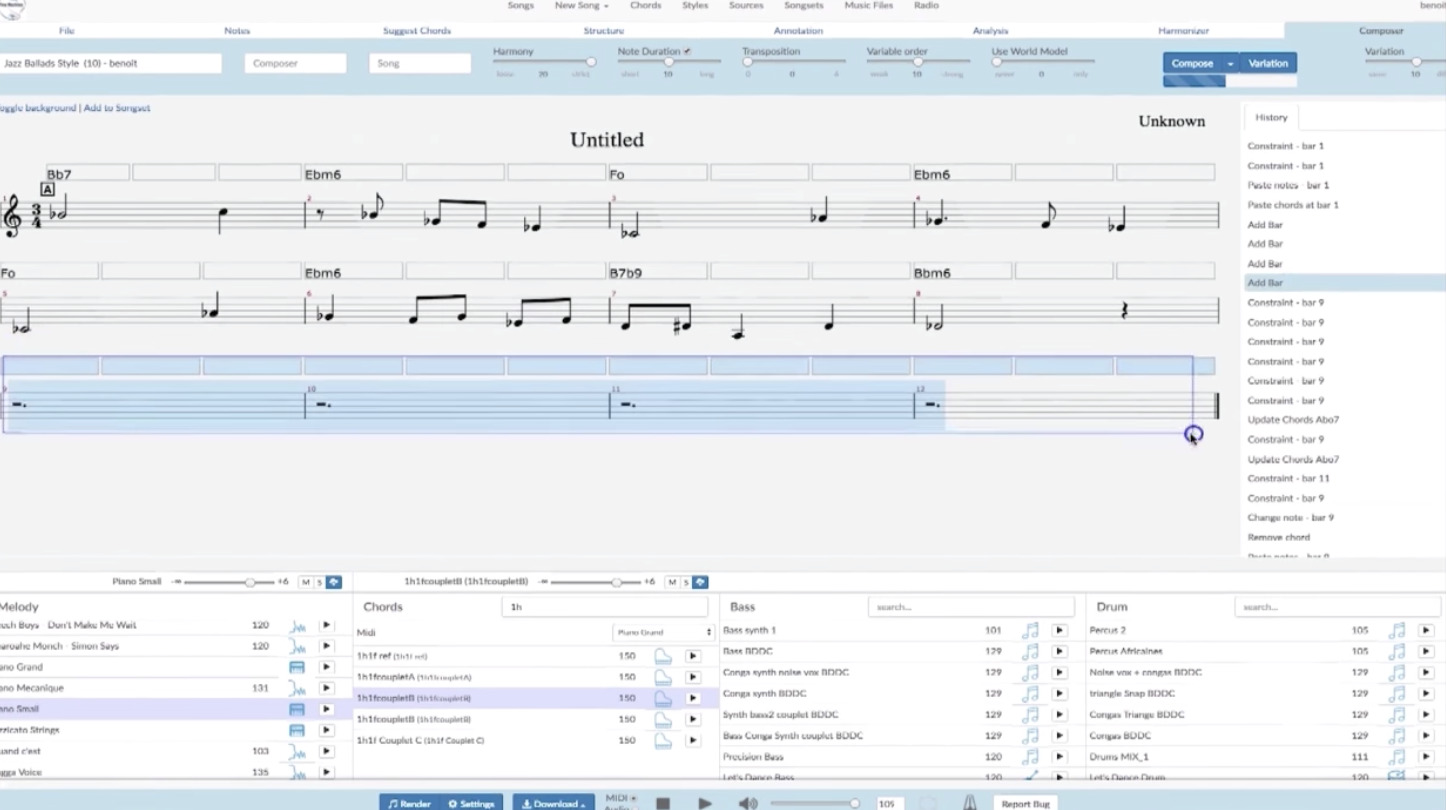

Flow Machinesは、もともとソニーCSLのパリのオフィスで20年近い期間掛けて研究されてきたもの。従来のシステムであるFlow Machines classicは、Francois Pachet博士により開発され、メロディーとコード進行を有する複数のLead Sheetを学習、メロディーの遷移確率とコードの遷移確率などをモデル化し、新しいメロディーとコード進行を得ることが特徴でした。2016年に発表されたビートルズ風な曲「Daddy’s Car」は、話題になったのでご存知の方も多いのではないでしょうか?

WebブラウザベースのUIだったパリ開発時代のFlow Machines Classic

WebブラウザベースのUIだったパリ開発時代のFlow Machines Classic

その後2017年ごろにソニーCSLの東京側のプロジェクトチームが発足とともに、Flow Machinesの研究開発をパリから東京へと徐々に移管していったのです。これにより従来のFlow Machines classicは東京で大きく改良され、Flow Machines professionalが誕生。その際のさまざまな進化を果たしているのですが、システム的にはFlow Machines classicがWebブラウザ上で動作し、MIDIデータをダウンロードする形になっていたのに対し、Flow Machines professionalはCubase上で動作するプラグインに進化しています。また後述しますが、学習のさせかたも大きく異なり、Flow Machines professionalでは、Style Paletteというデータセットを使って学習させているのも大きなポイントです。

東京でFlow Machines professionalへと進化し、Cubaseで動くプラグインの形になった

東京でFlow Machines professionalへと進化し、Cubaseで動くプラグインの形になった

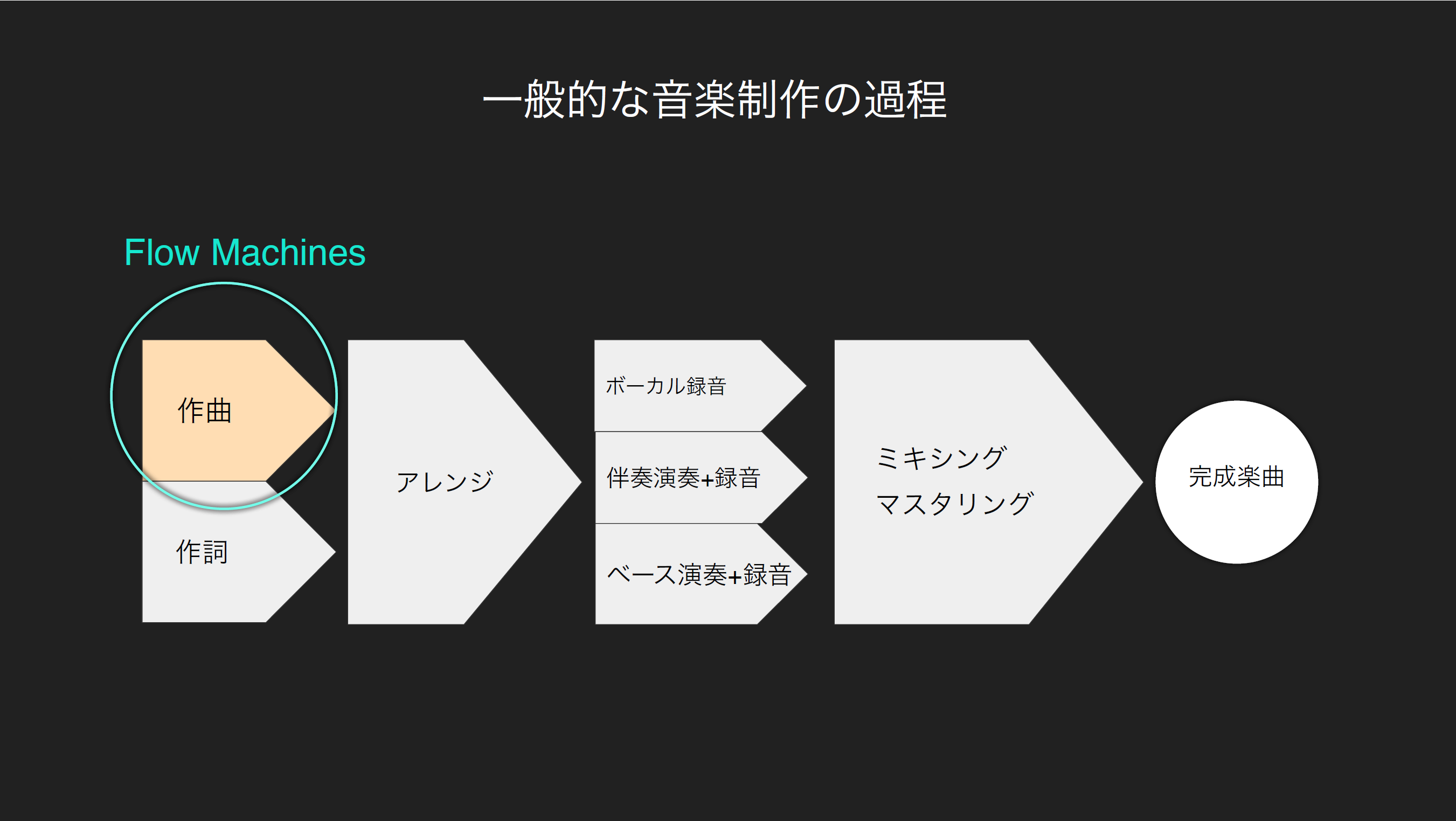

一般的な音楽制作の過程では、初めに作曲と作詞を行い、その後アレンジ、楽器やボーカルの録音、そしてミックスとマスタリングを行います。ソニーCSLでは、そのすべての音楽制作のプロセスに、AIを活用するツールを開発しているとのことで、東京、パリそれぞれで分担しながらプロジェクトを進めています。そして東京では作曲部分に集中した開発を行っており、それがFlow Machines professionalであるとのことです。

そんなFlow Machines professionalは、現在Cubaseを使って検証を行っており、ソニーミュージックの現場でもCubaseを使って制作が行われているとのこと。その理由について岸さんは、

「Flow Machines professionalは、VST/AUで動作するプラグインとして開発しているので、理論的にはどのDAWでも使うことが可能です。ただ、開発リソースの都合もあり、ソニー・ミュージックパブリッシング所属のクリエイターの方々も、Cubaseを使っている比率が圧倒的に高いので、Cubaseを標準DAWとして利用しています」とのこと。

メロディー、コード、ベースをAIで自動生成してくれるFlow Machines professional。ただ、すべてAIにお任せという使い方よりも、これを元に人がインスパイヤーを受けるとか、一部を利用して作曲や編曲に活用するという使い方がいいのだとか…。すでにこのFlow Machines professionalを作って制作された楽曲は発表されています。以下の動画は、ソニーミュージックが立ち上げた「Zeppでの撮り下ろしワンマンライブ」と「ファンコミュニケーション」の新しい有料配信コンテンツ「Dive/Connect @ Zepp Online」のオープニング曲「dive feat. Flow Machines」です。

「Dive/Connect @ Zepp Online」のOP曲

具体的にどの部分がAIなのか判断できますか?生成されたフレーズをクリエイターが編集したりしていますが、きっとピアノのユニークなフレーズなどがFlow Machines professionalで作られている部分だと思います。人間が作ったとしか思えないフレーズはもちろんのこと、こうした人間では思いつきにくいユニークなフレーズを生成できるのがAIの強みなのでしょうね。またソニーミュージックが運営しているLo-fi beatsチャンネル「Tokyo LosT Tracks -サクラチル-」というYouTubeチャンネルでも、Flow Machines professionalで作られた楽曲が流れています。実際に流れた楽曲は、以下の動画「lofi beats Tokyo LosT Tracks -サクラチル- with Flow Machines mix」で聴くことができるので、ぜひ再生してみてください。

「Tokyo LosT Tracks -サクラチル- -with Flow Machines mix」

いかがでしょうか?1時間程度の動画の中に何曲も入っているわけですが、全部Flow Machines professionalが使われているのです。また、「Tokyo LosT Tracks -サクラチル-」に楽曲「parkside in bloom」を提供したkensuke ushioさんのインタビュー動画があるので、こちらもぜひご覧ください。

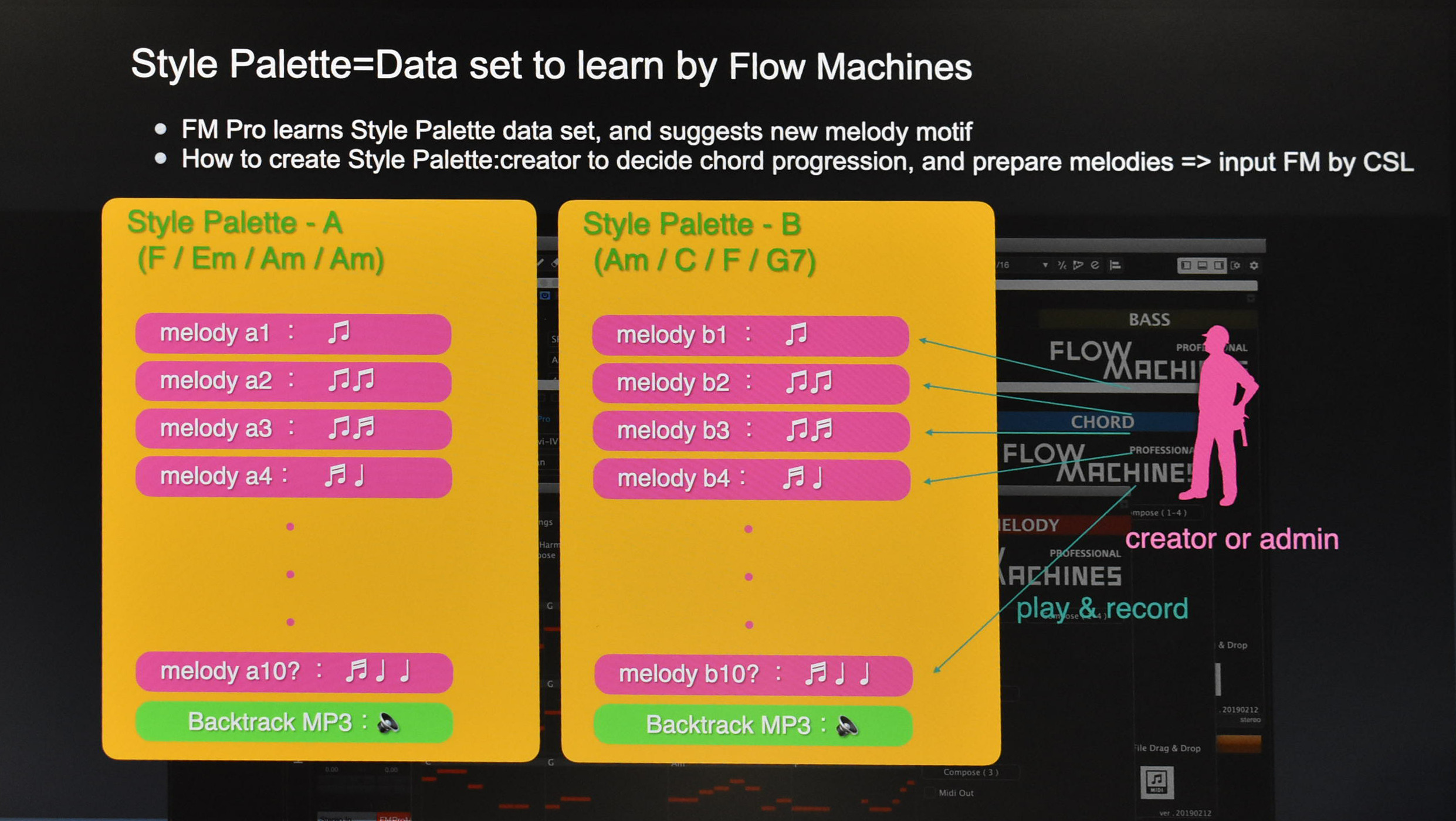

さて実際Flow Machines professionalが、どうやって学習しているか岸さんにお伺いしてみました。

「Style Paletteと呼んでいるものを使って、AI学習を行っています。以前は、ビートルズの楽曲を学習させたりしていましたが、現在はそのようなことは行っていません。Style Paletteは簡単にいうと、Flow Machinesの楽譜です。たとえば、F、Em、Am、Amというコード進行を先に決めておきます。このコード進行に合わせてクリエイターがメロディーを作り、8小節の塊にして、それを10パターンぐらい用意し学習させることによって、1つのStyle Paletteを作成しています。そうして現在、Style Paletteの数は100種類程度になりました。以前ビートルズの曲を学習していた頃は、コード進行をバラバラに学習させていました。しかし、それではAIから出力されるコード進行はバラバラになってしまい商業音楽では使いにくいものになっていました。なので、コード進行を揃えて学習させるようになったのです。画像の機械学習を行うときは、はじめ顔の部分をトリミングして学習させるので、音楽でも同じように音楽理論でトリミングして学習させるようにしています」とのこと。

また、オケの部分も先に作ってから学習させているらしく、そのことについて

「Backtrack MP3と呼んでいる、オケの部分も先に作っておくことで、曲のジャンルや曲のスタイルによって決まるメロディーを学習させるようにしています。というのも、コード進行が同じでもドラムのリズムパターンや楽器の編成によってメロディーが変わってくるので、より音楽的な学習を可能にするために、このような手法をとっています。バックトラックやStyle Paletteのメロディーは、プロの方に作っていただいているので、Flow Machines professionalが出力するメロディは商業音楽にレベルになるのです」と岸さん。

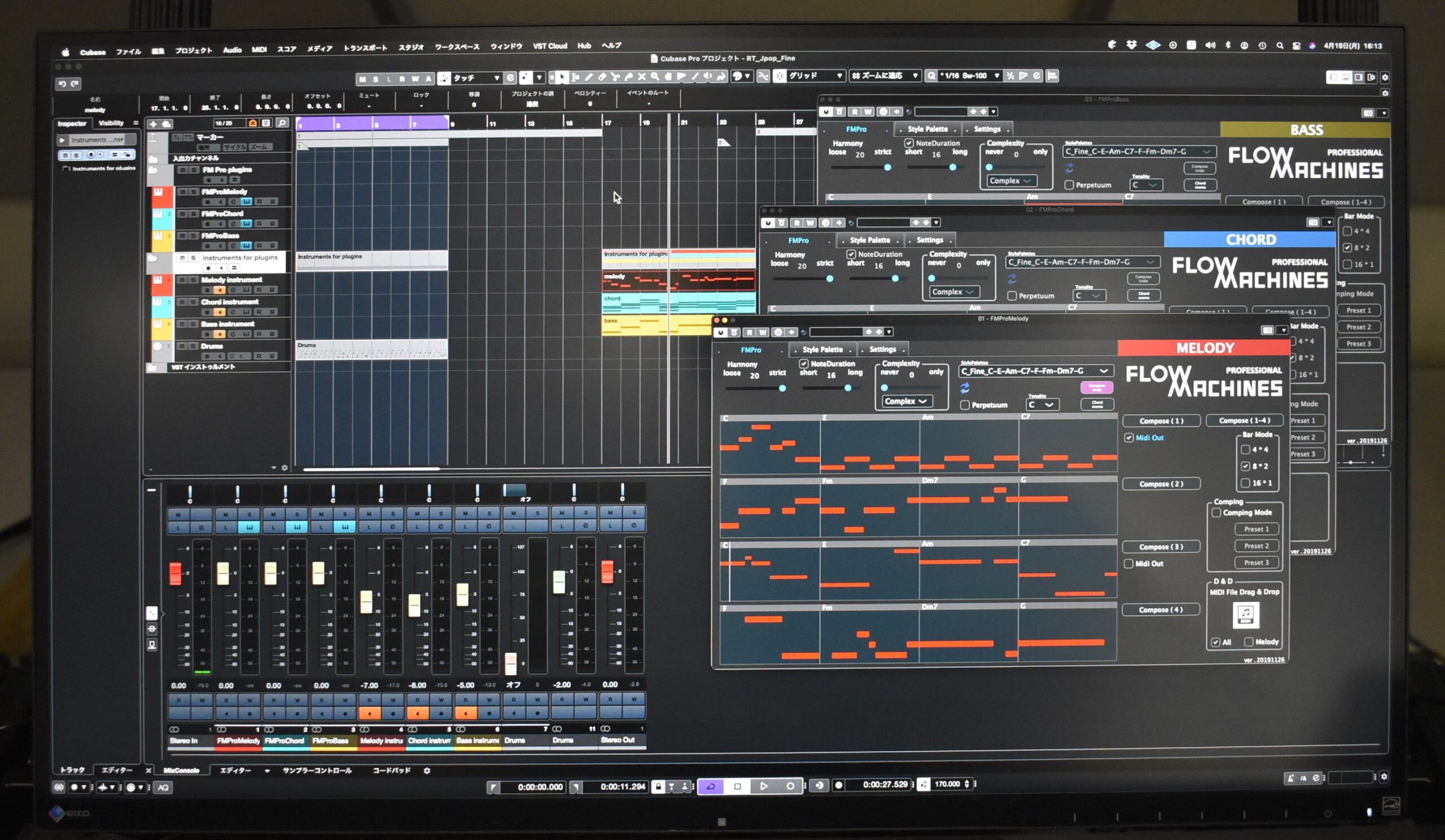

Cubase上に立ち上げたFlow Machines professionalを使って作曲を行う

Cubase上に立ち上げたFlow Machines professionalを使って作曲を行う

実際のFlow Machines professionalの使い方は簡単。Cubaseにトラックを作り、MELODY、CHORD、BASSの3種類のFlow Machines professionalプラグインをインサート。Flow Machines professional自体は音源を持っていないので、これが鳴るようにシンセなどを立ち上げてルーティングを行います。次にプリセットメニューのようなところから、Style Paletteを選びコード進行を決定していきます。そのほかのパラメータとしては、Harmony、NoteDurationがあり、Harmonyパラメータではコード進行に対してかなりキッチリとした音程になるか、外れた音も許容するかを設定し、NoteDurationは音符の長さを設定します。

音源は別に立ち上げて、Flow Machines professionalが出力したメロディを再生させる

音源は別に立ち上げて、Flow Machines professionalが出力したメロディを再生させる

その後、ComposeボタンをクリックするとFlow Machinesのサーバーにアクセスし、サーバーからMIDIデータが送られてきます。サーバーにアクセスするメリットとしては、巨大なデータセットをローカルに持つ必要がないことにあるとのこと。Composeボタンをクリックした後には、8小節分の自動作曲したMIDIデータが、Flow Machines professionalに2パターン分反映され、Midi Outにチェックが入っているパターンの方が再生されます。

ComposeボタンをクリックするとFlow MachinesのサーバーからMIDIデータが送られてくる

ComposeボタンをクリックするとFlow MachinesのサーバーからMIDIデータが送られてくる

また、もう1回Composeボタンをクリックすると、同じコード進行で2パターンが作曲されます。気に入ったメロディーやコード、ベースラインが出力されたら、それをDAWのトラックにドラッグ&ドロップして、そのままMIDIデータとして使用することが可能。また、でき上がった2パターンを1小節ずつ組み合わせる、コンピング機能なども装備しています。いずれもMIDIデータなので、後で自由にエディットすることも可能となっています。

今後のFlow Machinesの展開については、「ベースやコードなどのアレンジ機能を充実させつつ、パリとも連携を取って、音楽制作のすべてのプロセスをAIがサポートできるようにしていきたい」と岸さん。Flow Machinesが一般の人でも使えるようになるかは、担当者の方に伺ったところ検討中とのことでしたが、今後Flow Machinesがどう進化するかは楽しみですよね。

【関連情報】

Flow Machines公式サイト

Cubase製品情報

コメント